人工智能的能力常常让人觉得如同魔法一般——输入一句指令,瞬间就能获得流畅文案、可用代码,甚至生成逼真图像,无需复杂配置与漫长等待,便捷到让人误以为AI可以一键解决所有问题。

但这份“魔法感”,也让很多人对AI产生了不切实际的期待,忽略了其背后最核心的支撑:数据质量。AI从来不是万能魔法棒,它能优化流程、提升效率,却无法脱离基础条件凭空创造价值。AI的成功,始终离不开高质量数据、完善的基础设施,以及持续的迭代优化。

当下,AI正快速渗透到营销、销售、产品研发等各个行业,落地速度不断加快。可越来越多企业发现,再智能的AI系统,也无法突破劣质数据的局限。当AI的投入建立在混乱、错误、有偏见的数据之上时,最终只会换来不可靠的输出、资源的浪费,甚至埋下业务风险。有90%的数据专业人士表示,企业管理者对低质数据的重视程度远远不够。

AI的本质是学习数据中的规律,而非真正理解事实与真相。一旦输入的是不完整、不一致、带偏见的“垃圾数据”,输出的必然是错误、误导性的结果,这正是AI领域“垃圾进,垃圾出”的核心逻辑。

如今我们更少手动训练模型,更多依托ChatGPT这类预训练模型完成任务,但即便功能强大的预训练模型,也会被劣质数据拖累。以KNIME中文版打造的内部AI问答代理为例,这款代理可快速响应支持工单、社区咨询、内部信息查询等需求,替代人工检索文档与数据库。可一旦它接入的是碎片化、混乱、过时的数据,给出的答案就会敷衍、误导甚至完全错误。

低质数据的表现形式多样,但最终结果高度一致:让AI失去可靠性,带来高昂成本。

- 不完整:缺失关键信息,充斥无效内容

- 过时:脱离现实,无法反映当前真实情况

- 嘈杂:重复、矛盾、错误信息混杂,扭曲数据规律

- 偏见:来源偏颇、带有刻板印象,导致结果不公且误导人

即便是最顶尖的大语言模型(LLM),也难以处理糟糕的数据;而高质量数据,能让AI稳定发挥精准、高效的价值。

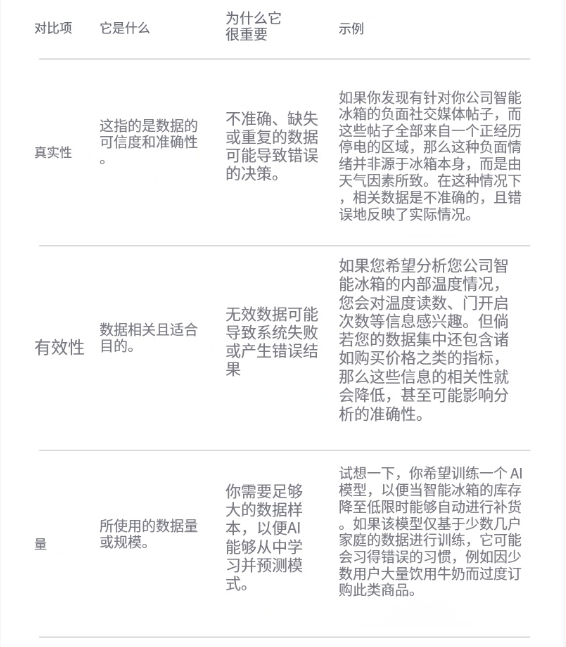

想要打造适配AI的可靠数据,核心要抓住数据质量的三大关键维度——真实性、有效性、数量。这三大核心指标,直接决定数据是否值得信赖,能否支撑AI产出准确、有意义的结果。

AI的“魔法”只是表象,数据质量才是其价值的底层支撑。当企业越来越依赖AI做决策,投入精力做好数据收集、清洗、维护这些基础工作,就变得愈发重要。当数据干净、一致、具备代表性时,AI才能真正释放价值,这才是AI领域最实在的“魔法”。